脳から送られる電気信号を読み取る!

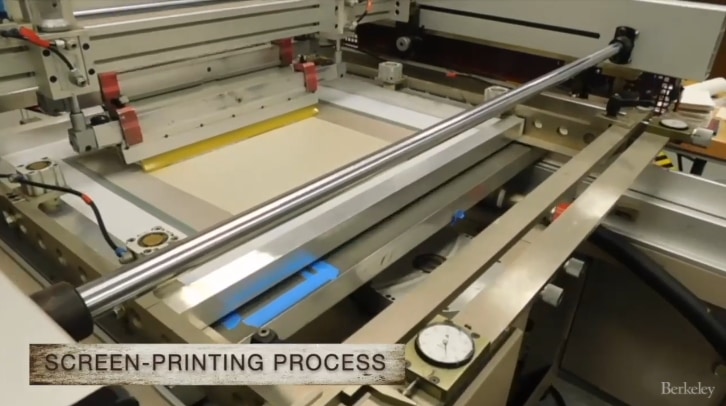

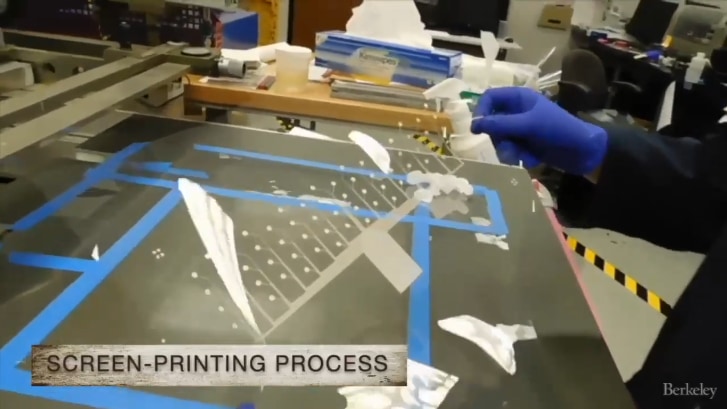

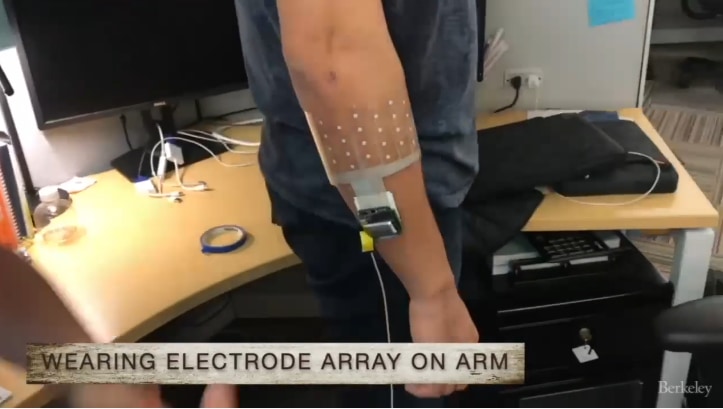

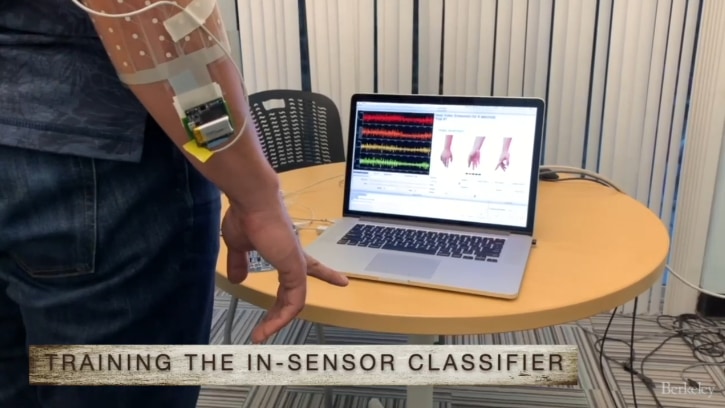

腕に巻きつけるようにして装着するセンサーは、スクリーン・プリンティングという技術をつかって作成されます。

前腕の64ヶ所で電気信号を測定し、そのデータを電気チップに内蔵されたAIが統合し、特定のジェスチャーとして解釈します。

研究チームのアリ・モイン氏は「人が手の筋肉を収縮させる際、脳がその動きの電気信号を首や肩のニューロン(神経)に沿って送り、腕や手の筋繊維に伝えます。

袖口に装着したセンサーが感知しているのはこの電気信号です。

これはセンサーが、前腕のどの筋繊維が動いているかを正確に特定できないという意味ではなく、脳から伝わってくる電気信号を読むことで、腕の動作パターンは再現できるということです」と説明します。

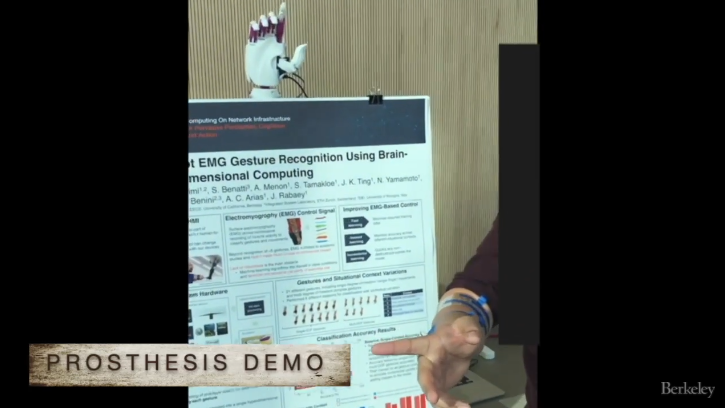

義手への応用が期待できるのはこのためです。

電気信号の解釈は、AIがオンボード(センサー内蔵)で行い、外部のクラウドコンピューターには依存しないため、データ解釈が迅速であり、利用者の安全性や機密性も確保されます。

同チームのジャン・ラバーエイ氏は「AIの学習スピードは非常に速く、一度の動作だけで即座に同じ動きを認識します。

また、何度も同じ動作を繰り返せば、その分だけ学習し、正確な腕の動きを作り上げます。まさに、人がするのと同じように絶えず学習するのです」と話します。

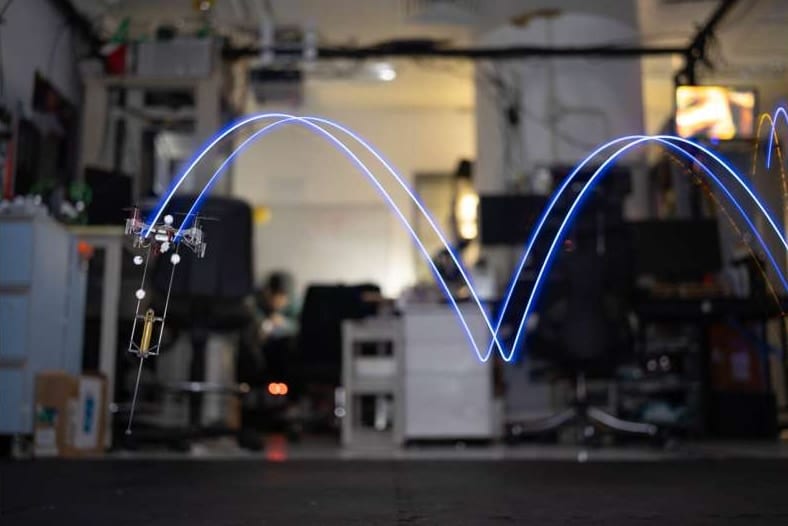

実際のテストでは、親指を立てたグッドサインや握りこぶし、指で数を数えるなど、21種類のジェスチャーの認識に成功しました。

さらに、このAIは「超次元コンピューティング・アルゴリズム」と呼ばれ、新しい情報を認識するたびに、自身を絶えずアップデートするようになっています。

例えば、ユーザーの皮膚が汗をかくことで電気信号が変化する場合、システムはこの新しい情報をデータ解釈に組み込んで、認識ミスが起きないようにします。

モイン氏は「実用化にはまだ解決すべき点が多々ありますが、将来的には、身障者の義手として活用できるようにしたい」と述べています。

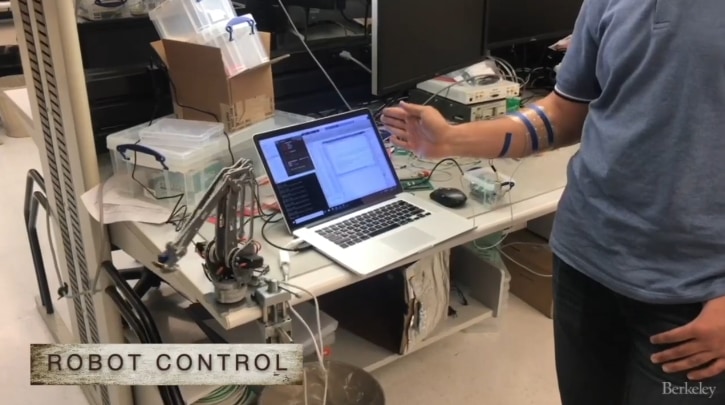

また、この技術を使えば、人とロボットの動きをシンクロさせられるようになるかも知れませんね。