AI普及のメリットと弊害

まるで人間と話しているように自然な文章でやり取りができるChatGPTや、指示通りの画像や映像を作り出すソフトウェアなど、AIはさまざまな分野で活用されるようになりました。

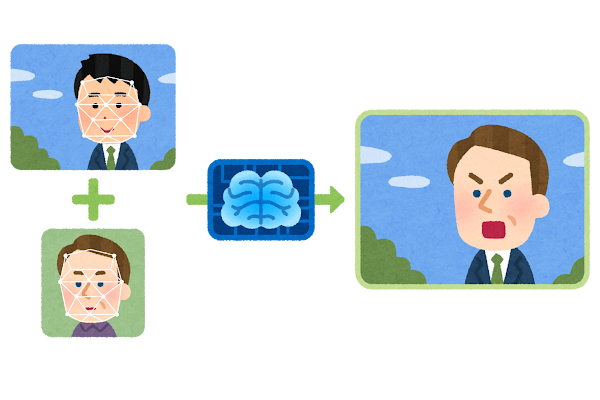

その中で、リアルな音声付きの映像を作り出す動画合成技術のことを「シンセティック・メディア」と呼び、ニュースの読み上げなどで活用されています。

シンセティック・メディアを使えば、合成される人を直接撮影することなく、その人がまるで話しているような映像を作り出すことが可能です。

機械を使用すれば、誤操作や読み間違えなどが無いうえに24時間対応可能で、多言語化も容易にできます。

人間のような動きや話し方を再現しながら人間よりも高度な対応ができ、ニュースだけではなくさまざまな場面で活用されていくでしょう。

シンセティック・メディアは便利で将来性が高い技術ではありますが、「ディープフェイク」による悪用につながる懸念点があります。

ディープフェイクを使用した犯罪や嫌がらせ

AIによる作り出した、フェイク動画や画像を「ディープフェイク」と呼びます。

以前、SNSでファッショナブルな白いダウンコートを着たローマ教皇の画像が話題となりました。

とてもローマ教皇が着ているものとは思えず、そのギャップに人々は興味をひいたのです。

しかし、このローマ教皇の画像はディープフェイクによる偽物だったのです。

かなりリアルな画像であったことから騙される人が続出しました。

また、ウクライナのゼレンスキー大統領がロシアに降伏すると宣言する動画が投稿されたこともありました。

すぐにウクライナ側が気が付き削除対応と偽動画であることの表明が行われ、大事には至りませんでした。

しかし、このような使われ方をすれば、ディープフェイクにより政治的に大きな曲面に影響するほどの事件が起こることも懸念されます。

実際にロンドン大学では、今後起こるAIによる脅威のNo.1は「ディープフェイク」だと発表しています(UCL)。

ディープフェイクは、有名人のフェイク動画を使って誰かを騙したり、その有名人の評判を落としたりすることも可能なのです。