AIに視覚情報と推論によって限定的な共感能力をもたせる

チェン氏らはヒトがもつ心の理論が、視覚情報と推論から得られていると考えました。

例えば、健康な若者は、高齢者が体を動かすのを辛そうにしている場面を何度も見ることで次第に共感できるようになります。

「おじいさんは立ち上がる時にいつも膝が痛そうにしている」という視覚情報から、「きっと次に立ち上がる時にも膝が痛むだろう」と推論するのです。

そしてチェン氏らは、同様の能力をAIに与えることに成功しました。そのことは、次の実験で証明されています。

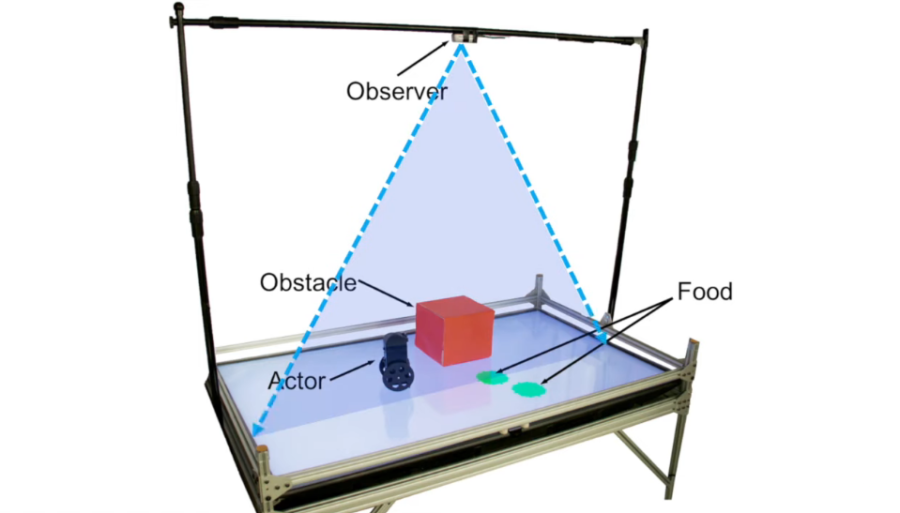

まず1つのロボットには、視野内で最も近い緑色スポットに移動するようプログラムしました。

時折、研究チームは赤いブロックによって最も近い緑色スポットが見えないようにし、ロボットが遠い緑スポットに移動するよう細工。

そして、ロボットがひたすらこのタスクを繰り返している様子を上方に設置したカメラを通してAIに2時間観察させ続けました。

これによりロボットと観察AIには視点の違いが生まれました。ロボットには見えていない部分がありますが、観察AIは俯瞰視点によってすべて見えているのです。